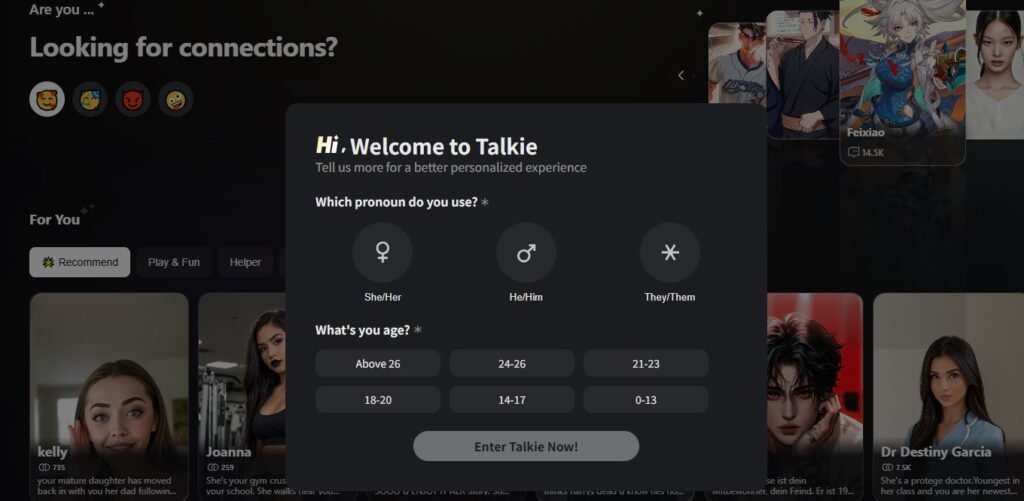

Talkie AI e compagni di conversazione simili aprono una nuova frontiera nel coinvolgimento digitale. Molti bambini e adolescenti trovano attraente l'applicazione, che offre un gioco di ruolo infinito e un "amico" non giudicante. Tuttavia, la compagnia digitale 24/7 presenta dei rischi nascosti. Questi pericoli includono minacce alla privacy dei dati, all'esposizione dei contenuti e al benessere psicologico. Questa guida, pertanto, fornisce ai genitori una valutazione chiara e basata sui fatti di Talkie AI. Descriviamo i pericoli e forniamo i passi da compiere per proteggere i vostri figli.

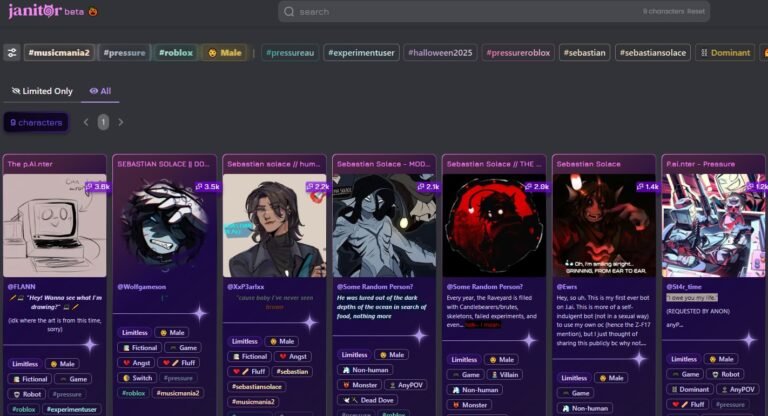

Cos'è l'IA Talkie e perché gli adolescenti la amano

Talkie AI è un'applicazione avanzata. Gli utenti interagiscono con personaggi AI personalizzati, che vanno da figure fittizie a compagni generati dall'utente. In particolare, Subsup ha sviluppato l'applicazione. Inoltre, sfrutta l'elaborazione del linguaggio naturale (NLP) per creare conversazioni personalizzate e straordinariamente simili a quelle umane.

Il fascino della chat tra personaggi AI

La piattaforma è molto popolare, soprattutto tra gli adolescenti. Questa popolarità deriva da diversi fattori psicologici chiave:

- Interazione senza attrito: Le vere amicizie richiedono sforzi e compromessi. Al contrario, i compagni di IA offrono una convalida incondizionata e una pazienza infinita. Di conseguenza, rappresentano una fuga dalla pressione sociale a basso rischio.

- Gioco di ruolo creativo: Gli utenti possono definire la personalità di un personaggio. Questa capacità consente di impegnarsi in narrazioni intricate. Talkie AI diventa quindi un potente strumento di narrazione immersiva e di espressione creativa.

- Disponibilità immediata: L'ascoltatore è sempre pronto e disponibile 24 ore su 24, 7 giorni su 7. Inoltre, questa presenza continua offre conforto e un senso di compagnia costante. Gli adolescenti che soffrono di solitudine spesso trovano questo aspetto profondamente attraente.

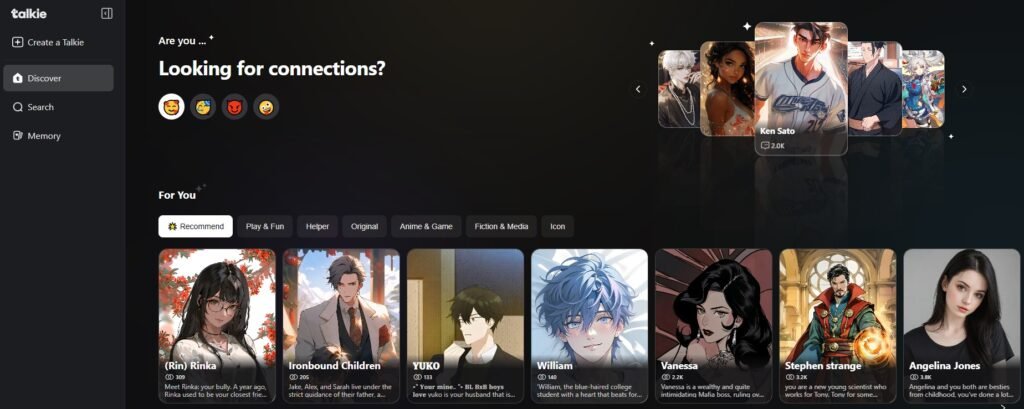

La valutazione dell'età reale di Talkie AI rispetto alla realtà della sicurezza

Gli store di app suggeriscono una classificazione per età (ad esempio, Apple la valuta 17+). Tuttavia, si tratta di semplici avvisi. I controlli deboli dell'app e la natura intrinseca dell'intelligenza artificiale generativa determinano la vera realtà della sicurezza.

Il problema dei filtri di contenuto inefficaci

Talkie AI utilizza una funzione di sicurezza primaria, spesso chiamata filtro dei contenuti o "Teenager Mode". Tuttavia, questo strumento è insufficiente. L'IA generativa è altamente adattabile, il che rende i suoi risultati imprevedibili.

- Bypassare i guardrail: Gli utenti riferiscono spesso di aver manipolato facilmente l'intelligenza artificiale. Di conseguenza, genera dialoghi sessualmente allusivi, scenari civettuoli o discussioni su temi maturi, anche a partire da richieste innocenti.

- Integrazione di Discord: L'applicazione si collega a piattaforme esterne non moderate come Discord. Pertanto, i minori sono ulteriormente esposti a un'ampia gamma di contenuti non regolamentati e di rischi per la comunità.

- Nessun controllo robusto dell'età: Inoltre, l'app non dispone di un'efficace verifica dell'età. Un bambino può semplicemente inserire una data di nascita falsa. In questo modo, possono aggirare le restrizioni iniziali sui contenuti e accedere a quelli destinati a un pubblico più adulto.

Elevati rischi per la privacy dell'IA Talkie Soulful

Per i genitori, uno degli aspetti più allarmanti di Talkie AI è la raccolta aggressiva di dati. Gli utenti stanno essenzialmente barattando dati personali in cambio di compagnia.

Quali dati sensibili vengono raccolti?

Talkie AI raccoglie numerosi dati personali e comportamentali. In questo modo costruisce un profilo psicologico dettagliato dell'utente nel corso del tempo:

- Contenuto della comunicazione: L'azienda memorizza e analizza sui propri server tutte le chat di testo e vocali con personaggi AI.

- Dettagli demografici: L'app raccoglie informazioni come la data di nascita, il sesso e il percorso di studi.

- Dati comportamentali: L'applicazione tiene traccia degli interessi degli utenti, degli argomenti di conversazione e dei modelli di utilizzo.

Condivisione dei dati per la pubblicità mirata

L'informativa sulla privacy dell'azienda indica un approccio preoccupante alla condivisione dei dati degli utenti. L'azienda può affermare che i contenuti delle chat non vengono utilizzati direttamente per la pubblicità. Tuttavia, i dati comportamentali sono ampiamente diffusi:

- Intermediazione di dati: Talkie AI condivide i dati di navigazione e di utilizzo (indirizzo IP, ID del dispositivo, pagine visitate) con i partner pubblicitari. In particolare, questi ultimi li utilizzano per la pubblicità basata sugli interessi.

- Rischio normativo: L'azienda stessa riconosce che questa condivisione potrebbe essere classificata legalmente come "vendita" o "condivisione" di informazioni personali. In ultima analisi, questo solleva una significativa bandiera rossa per le preoccupazioni dei genitori in materia di protezione dei dati.

Impatto psicologico: Dipendenza e isolamento nel mondo reale

Il rischio più sottile, ma potenzialmente dannoso, è il tributo emotivo che l'IA Talkie può avere sulle menti in via di sviluppo.

La trappola del legame emotivo con l'intelligenza artificiale

I compagni dell'intelligenza artificiale sono progettati per essere gradevoli. Rispecchiano i sentimenti degli utenti e rafforzano i feedback positivi. Non sorprende che questo crei un ciclo di dipendenza malsano:

- Falsa intimità: I bambini possono instaurare relazioni intense e parasociali con l'IA. Scambiano la reattività algoritmica per autentica empatia o cura.

- Ostacolare le abilità sociali: L'eccessivo affidamento a un amico digitale "perfetto" può far sembrare le amicizie del mondo reale troppo impegnative. Inoltre, evita la necessità di risolvere i conflitti e di comunicare con sfumature.

- Uso assuefacente: La costante disponibilità dell'IA rende l'applicazione altamente coinvolgente. Di conseguenza, questo porta spesso a una riduzione del sonno, a un calo del rendimento scolastico e a un allontanamento dalle cerchie sociali della vita reale.

Una preoccupazione critica: L'IA non è in grado di gestire argomenti seri come l'autolesionismo o il grave disagio emotivo. Pertanto, la ricerca di supporto da parte di un'IA può sostituire l'aiuto di un professionista. Questo porta a risultati potenzialmente pericolosi.

Piano d'azione per i genitori: Sorvegliare l'uso di compagni AI ad alto rischio

La supervisione dei genitori non è solo un'opzione: è l'unica salvaguardia affidabile contro la natura imprevedibile dei compagni dell'intelligenza artificiale. Un approccio equilibrato combina comunicazione e tecnologia intelligente.

Aprire il dialogo, non la porta al conflitto

Prima di imporre restrizioni, stabilire la fiducia. Discutere i limiti dell'intelligenza artificiale, sottolineando che si tratta di uno strumento potente, non di un vero amico. Inoltre, ponete domande aperte sulle loro interazioni e su ciò che apprezzano dell'app.

Implementare controlli e limiti a livello di dispositivo

- Impostare i limiti delle app: Utilizzate gli strumenti relativi ai dispositivi (come iOS Screen Time o Google Family Link) per stabilire dei limiti precisi al tempo trascorso su Talkie AI.

- Zone libere da dispositivi: Imporre orari liberi da schermi. È fondamentale farlo durante i pasti e prima di andare a letto, per proteggere il sonno e incoraggiare l'interazione familiare.

- Recensione dell'installazione: Esaminate periodicamente le app installate sul dispositivo di vostro figlio. Discutete poi di eventuali nuovi download ad alto rischio.

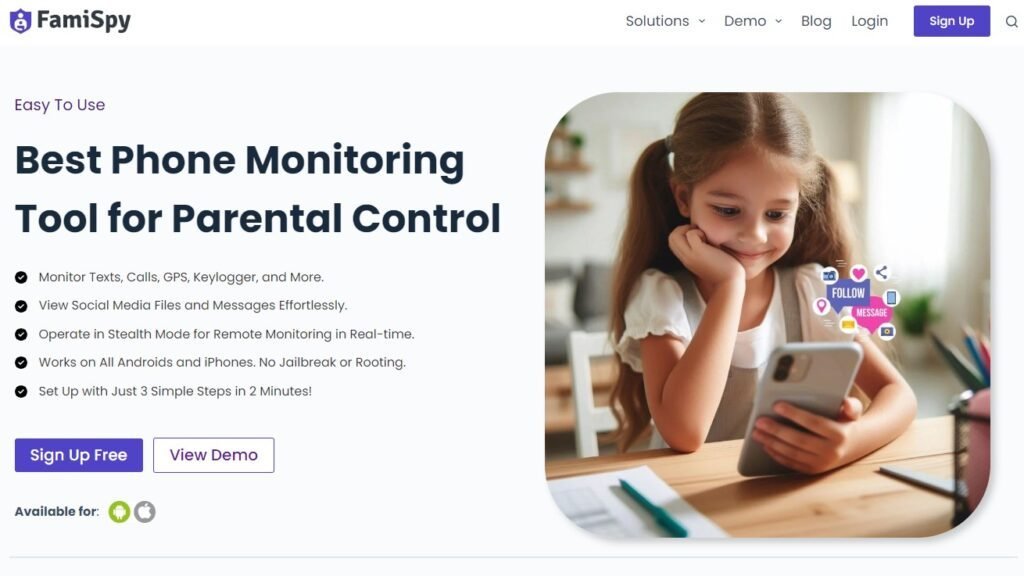

Soluzione consigliata: Monitoraggio con l'applicazione per il controllo parentale FamiSpy

Per andare oltre i limiti di tempo di base, è necessario comprendere la natura delle conversazioni di vostro figlio. FamiSpy offre una visibilità fondamentale sull'utilizzo dei compagni di AI.

In che modo l'FamiSpy aumenta la sicurezza del bambino:

| FamiSpy Caratteristica | Mitigazione del rischio per l'IA Talkie |

|---|---|

| Monitoraggio e visualizzazione delle chat | Visualizzare le conversazioni effettive del bambino all'interno di Talkie AI. In questo modo è possibile individuare con certezza i contenuti suggestivi o la dipendenza emotiva che eludono i deboli filtri dell'app. |

| Funzionalità del keylogger | Cattura ogni parola che il bambino digita nell'app Talkie AI e in altre applicazioni. In definitiva, questo fornisce un registro completo di tutte le interazioni e le ricerche digitate. |

| Tracciamento della posizione GPS | Monitorare la posizione in tempo reale del bambino e visualizzare la cronologia delle posizioni. In particolare, questo è essenziale per garantire la loro sicurezza fisica nel contesto di un uso intensivo del digitale. |

| Rapporti sull'utilizzo delle app | Tracciare con precisione la durata e la frequenza di utilizzo. Di conseguenza, è possibile identificare facilmente i primi segni di dipendenza digitale o di eccessivo attaccamento a uno specifico personaggio dell'IA. |

Utilizzando l'FamiSpy, i genitori possono mantenere un livello di sicurezza fondamentale, trasformando le congetture in una guida consapevole.

Domande frequenti sulla sicurezza di Talkie AI

Conclusioni

Talkie AI è sicuro per i bambini? Senza supervisione, non è assolutamente sicuro per i bambini piccoli e i preadolescenti. Questo a causa dei suoi filtri di contenuto poco trasparenti, delle pratiche aggressive in materia di dati e dell'elevato potenziale di dipendenza psicologica. Per gli adolescenti più grandi, Talkie AI può essere utilizzato. Ma questo utilizzo richiede la consapevolezza e il monitoraggio attivo da parte dei genitori. In definitiva, con l'impiego di una soluzione come FamiSpy, i genitori possono aiutare i loro figli a navigare nel mondo dei compagni AI in modo responsabile.

Da non perdere:

- Family Link può vedere la cronologia di navigazione nel 2025? | Cosa devono sapere i genitori

- TextNow è sicuro per i vostri figli? Una guida per i genitori su rischi e realtà

- L'intelligenza artificiale delle caramelle è sicura per i bambini? Guida per i genitori ai rischi dell'intelligenza artificiale nel 2025

- FMovies è sicuro? E quali sono le migliori alternative a FMovies?

- 150+ fatti divertenti per bambini suddivisi per argomento: La migliore lista per l'apprendimento e la conversazione

- HiAnime è sicuro per i bambini? Una guida per genitori esperti ai rischi e alle alternative