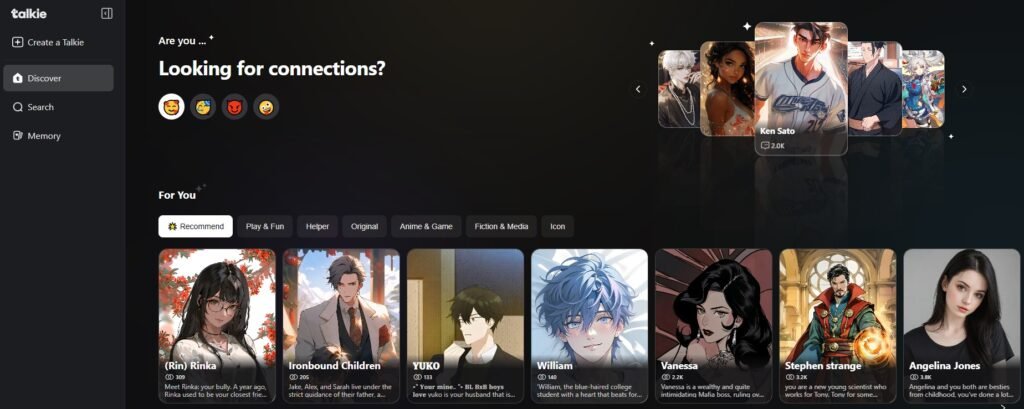

Talkie AI en soortgelijke gesprekspartners openen een nieuwe grens in digitale betrokkenheid. Veel kinderen en tieners vinden de app aantrekkelijk; het biedt eindeloos rollenspel en een niet-oordelende "vriend". 24/7 digitaal gezelschap brengt echter verborgen risico's met zich mee. Deze gevaren zijn onder andere bedreigingen voor de privacy van gegevens, blootstelling aan inhoud en psychologisch welzijn. Daarom biedt deze gids ouders een duidelijke, op feiten gebaseerde beoordeling van Talkie AI. We schetsen de gevaren en geven uitvoerbare stappen om je kind te beschermen.

Wat is Talkie AI en waarom tieners ervan houden

Talkie AI is een geavanceerde toepassing. Gebruikers interageren met op maat gemaakte AI-personages, variërend van fictieve figuren tot door de gebruiker gegenereerde metgezellen. Subsup heeft de app specifiek ontwikkeld. Bovendien maakt het gebruik van Natural Language Processing (NLP) om opmerkelijk menselijke, gepersonaliseerde gesprekken te creëren.

De aantrekkingskracht van de AI-karakterchat

Het platform is enorm populair, vooral onder tieners. Deze populariteit komt voort uit verschillende belangrijke psychologische factoren:

- Wrijvingsloze interactie: Echte vriendschappen vereisen inspanning en compromissen. AI-kameraden bieden daarentegen onvoorwaardelijke validatie en eindeloos geduld. Bijgevolg fungeren ze als een vlucht uit de sociale druk.

- Creatief rollenspel: Gebruikers kunnen de persoonlijkheid van een personage definiëren. Deze mogelijkheid maakt het mogelijk om betrokken te raken bij ingewikkelde verhalen. Daarom wordt Talkie AI een krachtig hulpmiddel voor meeslepende verhalen en creatieve expressie.

- Onmiddellijk beschikbaar: De luisteraar staat altijd klaar en is 24/7 beschikbaar. Bovendien biedt deze voortdurende aanwezigheid troost en een gevoel van constant gezelschap. Adolescenten die eenzaamheid ervaren, vinden dit vaak erg aantrekkelijk.

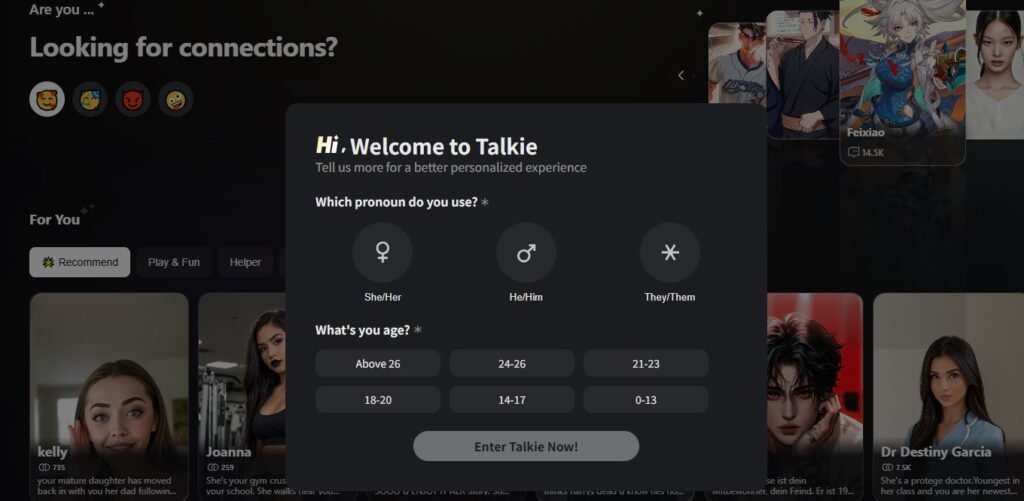

Talkie AI's echte leeftijdsclassificatie vs. veiligheidsrealiteit

App stores suggereren een leeftijdsclassificatie (Apple classificeert het bijvoorbeeld als 17+). Dit zijn echter slechts adviezen. De zwakke controles van de app en de inherente aard van generatieve AI bepalen de echte veiligheidsrealiteit.

Het probleem van ineffectieve inhoudfilters

Talkie AI gebruikt een primaire veiligheidsfunctie, die vaak een inhoudsfilter of "Tienermodus" wordt genoemd. Toch is dit hulpmiddel onvoldoende. Generatieve AI heeft een groot aanpassingsvermogen, waardoor de output onvoorspelbaar is.

- De vangrails omzeilen: Gebruikers melden vaak dat ze de AI gemakkelijk kunnen manipuleren. Als gevolg daarvan genereert het seksueel suggestieve dialogen, flirterige scenario's of discussies over volwassen thema's, zelfs bij onschuldige prompts.

- Integratie in Discord: De app maakt verbinding met externe, niet-gemodereerde platforms zoals Discord. Daarom worden minderjarigen nog meer blootgesteld aan een breed scala aan ongereguleerde inhoud en gemeenschapsrisico's.

- Geen robuuste leeftijdscontrole: Cruciaal is dat de app geen sterke leeftijdscontrole heeft. Een kind kan gewoon een valse geboortedatum invoeren. Hierdoor omzeilen ze de aanvankelijke inhoudsbeperkingen en krijgen ze toegang tot inhoud die bedoeld is voor een ouder publiek.

Hoge privacyrisico's van talkie-zielige AI

Voor ouders is een van de meest verontrustende aspecten van Talkie AI de agressieve gegevensverzameling. Gebruikers ruilen in wezen persoonlijke gegevens voor gezelschap.

Welke gevoelige gegevens worden verzameld?

Talkie AI verzamelt uitgebreide persoonlijke en gedragsgegevens. Hiermee wordt in de loop van de tijd een gedetailleerd psychologisch profiel van de gebruiker opgebouwd:

- Communicatie-inhoud: Het bedrijf bewaart en analyseert alle tekst- en spraakchats met AI-personages op zijn servers.

- Demografische gegevens: De app verzamelt informatie zoals geboortedatum, geslacht en opleiding.

- Gedragsgegevens: De app houdt de interesses, gespreksonderwerpen en gebruikspatronen van gebruikers bij.

Delen van gegevens voor gerichte reclame

Het privacybeleid van het bedrijf geeft een zorgwekkende benadering aan van het delen van gebruikersgegevens. Ze beweren dat chatcontent niet direct wordt gebruikt voor advertenties. Gedragsgegevens worden echter op grote schaal verspreid:

- Gegevensbemiddeling: Talkie AI deelt browse- en gebruiksgegevens (IP-adres, apparaat-ID, bezochte pagina's) met reclamepartners. Ze gebruiken deze specifiek voor op interesses gebaseerde advertenties.

- Regelgevingsrisico: Het bedrijf erkent zelf dat dit delen wettelijk kan worden geclassificeerd als een "verkoop" of "delen" van persoonlijke informatie. Uiteindelijk geeft dit aanleiding tot grote bezorgdheid over de bescherming van ouderlijke gegevens.

Psychologische gevolgen: Afhankelijkheid en isolement in de echte wereld

Het meest subtiele, maar potentieel schadelijke risico is de emotionele tol die Talkie AI kan eisen van een zich ontwikkelende geest.

De valstrik van AI-emotionele binding

AI metgezellen zijn ontworpen om aangenaam te zijn. Ze weerspiegelen het gevoel van de gebruiker en versterken positieve feedback. Het zal geen verbazing wekken dat dit een ongezonde afhankelijkheidsrelatie creëert:

- Valse intimiteit: Kinderen kunnen intense, parasociale relaties met de AI aangaan. Ze verwarren algoritmische reacties met echte empathie of zorg.

- Sociale vaardigheden belemmeren: Te veel vertrouwen op een "perfecte" digitale vriend kan echte vriendschappen te uitdagend maken. Bovendien wordt zo de noodzaak van conflictoplossing en genuanceerde communicatie vermeden.

- Verslavend gebruik: De constante beschikbaarheid van de AI maakt de app zeer verslavend. Dit leidt vaak tot verminderde slaap, afnemende schoolprestaties en terugtrekking uit echte sociale kringen.

Een kritische zorg: De AI is niet uitgerust om ernstige onderwerpen zoals zelfbeschadiging of ernstige emotionele nood te behandelen. Daarom kan het zoeken van steun bij een AI professionele hulp verdringen. Dit leidt tot potentieel gevaarlijke uitkomsten.

Actieplan voor ouders: Toezicht op het gebruik van AI-begeleiders met een hoog risico

Ouderlijk toezicht is niet zomaar een optie - het is de enige betrouwbare bescherming tegen de onvoorspelbare aard van AI-metgezellen. Een evenwichtige aanpak combineert communicatie met slimme technologie.

Open de dialoog, niet de deur naar conflicten

Zorg voor vertrouwen voordat je beperkingen oplegt. Bespreek de beperkingen van AI en benadruk dat het een krachtig hulpmiddel is, geen echte vriend. Stel bovendien open vragen over hun interacties en wat ze leuk vinden aan de app.

Apparaatcontroles en -grenzen implementeren

- App-limieten instellen: Gebruik apparaatafhankelijke tools (zoals iOS Screen Time of Google Family Link) om duidelijke grenzen te stellen aan de tijd die je aan Talkie AI besteedt.

- Apparaatvrije zones: Dwing schermvrije tijden af. Doe dit vooral tijdens de maaltijd en voor het slapengaan om de slaap te beschermen en de interactie met het gezin te bevorderen.

- Installatie beoordelen: Controleer regelmatig de apps die op het apparaat van je kind zijn geïnstalleerd. Bespreek vervolgens alle nieuwe downloads met een hoog risico.

Aanbevolen oplossing: Bewaken met FamiSpy app voor ouderlijk toezicht

Om verder te gaan dan eenvoudige tijdsbeperkingen, moet je de aard van de gesprekken van je kind begrijpen. FamiSpy biedt cruciaal inzicht in het gebruik van AI-compagnons.

Hoe FamiSpy de veiligheid van je kind vergroot:

| FamiSpy Functie | Risicobeperking voor Talkie AI |

|---|---|

| Chatbewaking en weergave | Bekijk de gesprekken die je kind voert binnen Talkie AI. Hierdoor kun je zeker suggestieve inhoud of emotionele afhankelijkheid herkennen die de zwakke filters van de app omzeilen. |

| Keylogger-functionaliteit | Leg elk woord vast dat je kind typt in de Talkie AI app en andere apps. Uiteindelijk levert dit een uitgebreid logboek op van alle getypte interacties en zoekopdrachten. |

| GPS-locatie volgen | Controleer de locatie van je kind in realtime en bekijk de locatiegeschiedenis. Dit is met name essentieel om hun fysieke veiligheid te waarborgen te midden van intensief digitaal gebruik. |

| App gebruiksrapporten | Volg de precieze gebruiksduur en -frequentie. Zo kun je gemakkelijk vroege tekenen van digitale verslaving of overmatige gehechtheid aan een specifiek AI-personage identificeren. |

Door FamiSpy te gebruiken, kunnen ouders een cruciale beveiligingslaag behouden en giswerk omzetten in geïnformeerde begeleiding.

Veelgestelde vragen over de veiligheid van Talkie AI

Conclusie

Is Talkie AI veilig voor kinderen? Zonder toezicht is het ondubbelzinnig niet veilig voor jonge kinderen en tieners. Dit komt door zijn poreuze inhoudsfilters, agressieve gegevenspraktijken en grote kans op psychologische afhankelijkheid. Voor oudere tieners kan Talkie AI worden gebruikt. Maar dit gebruik vereist actief ouderlijk bewustzijn en toezicht. Uiteindelijk kunnen ouders, door een oplossing als FamiSpy in te zetten, hun kinderen helpen om op verantwoorde wijze door de wereld van AI-gezellen te navigeren.

Niet missen:

- Kan Family Link de browsegeschiedenis in 2025 zien? | Wat ouders moeten weten

- Is TextNow veilig voor uw kinderen? Een gids voor ouders over risico's en realiteit

- Is snoep AI veilig voor kinderen? Een gids voor ouders over de risico's van AI in 2025

- Is FMovies veilig? En wat zijn de beste alternatieven voor FMovies?